Что такое краулинговый бюджет и как его оптимизировать для SEO.

Понимание значения краулингового бюджета и его оптимизации для целей SEO очень важно. Да, это очень техническая тема и поэтому большинство веб-мастеров стараются её избегать. Но для успешного продвижения сайта, эту тему нужно знать.

В этом руководстве вы узнаете простым языком, что такое бюджет сканирования (и связанные с ним термины, а также то, как это влияет на SEO и какие действия вы можете предпринять для оптимизации.

Что такое краулинговый бюджет?

Краулинговый бюджет — это не одно число, а общий термин, который описывает, как часто и сколько страниц Google сканирует и индексирует с определенного веб-сайта в течение определенного периода времени.

Факторами, влияющими на краулинговый бюджет, являются веб-сайт и структура навигации, дублированный контент (внутри сайта), программные ошибки 404, страницы с низким качеством, скорость веб-сайта и проблемы со взломом.

Почему краулинговый бюджет важен для SEO?

С самого начала следует подчеркнуть, что это не является фактором ранжирования.

То есть, от него напрямую не зависит, какие позиции будет занимать сайт в поисковой выдаче.

Но краулинговый бюджет важен для SEO и вот почему:

Что такое оптимизация краулингового бюджета?

Оптимизация краулингового бюджета — это процесс проверки, что поисковые системы могут сканировать и индексировать все важные страницы вашего сайта в короткий срок.

Оптимизация краулингового бюджета обычно не является проблемой для небольших веб-сайтов, но для крупных сайтов, с тысячами URL-адресов, это важно.

Тем не менее, вы можете оптимизировать свой краулинговый бюджет.

Совет: если термины «сканирование» и «индексирование» являются новыми для вас, то настоятельно рекомендую вам прочитать, как работают поисковые системы. Это поможет вам понять, что сканирование и индексация имеют решающее значение для SEO.

Как оптимизировать краулинговый бюджет для SEO

1. Обеспечьте правильную иерархическую структуру сайта

Когда роботы поисковых систем посещают сайт, они начинают с домашней страницы, а затем переходят по любым ссылкам, чтобы обнаружить, просканировать и проиндексировать все страницы сайта.

Иерархическая структура сайта с глубиной не более 3-х уровней является идеальной структурой любого веб-сайта.

Это означает, что к путь к любой страницы сайт, должен быть не более чем в трех кликах от главной страницы сайта.

Такая простая простая структура облегчает и ускоряет сканирование, а также это полезно для обычных пользователей.

2. Оптимизация внутренних ссылок

Когда речь идет про сканирование и индексацию, поисковики предпочитают уделять больше внимания наиболее важным страницам сайта.

Один из способов, которые они используют для распознавания важных страниц, это подсчет внешних и внутренних ссылок, которые ведут на страницу.

Внешние ссылки важнее, но их сложнее получить, в то время как внутренними ссылками, веб-мастеру намного легче управлять.

Оптимизация внутренних ссылок означает:

Наличие страниц на вашем сайте, которые не имеют внутренних или внешних ссылок, усложняет работу роботов поисковых систем и тратит ваш краулинговый бюджет.

3. Повысьте скорость вашего сайта

Скорость является важным фактором ранжирования, большим фактором юзабилити и фактором, влияющим на краулинговый бюджет.

Проще говоря, когда веб-сайт загружается быстро, роботы поисковиков смогут отсканировать большее количество страниц за меньшее время. Это признак здоровой структуры сайта и стимул для поисковых роботов почаще наведываться на такой сайт.

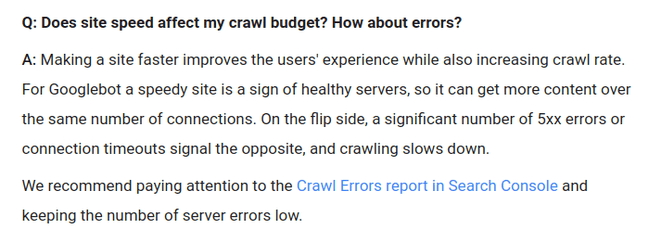

О том, что на краулинговый бюджет напрямую влияет скорость сайта, напрямую говориться в блоге Гугл для веб-мастеров.

Как веб-мастер, вы должны приложить все усилия, чтобы веб-страницы загружались максимально быстро на всех устройствах.

4. Решить проблему с дубликатами

Один из факторов, которые могут негативно повлиять на краулинговый бюджет, является дублированный контент на сайте.

Дублированный контент в этом контексте — идентичный или очень похожий контент, появляющийся на нескольких URL на вашем сайте.

Это очень распространенная проблема на страницах категорий электронной коммерции, где похожие продукты могут быть перечислены в нескольких категориях.

Помимо сайтов электронной коммерции, у блогов тоже могут быть проблемы с дублированным контентом. Например, если у вас есть несколько страниц, ориентированных на одни и те же ключевые слова, и контент на этих страницах похож, то Google может рассматривать это как дублирующийся контент.

Как дублированный контент влияет на бюджет сканирования?

Это усложняет работу поисковых роботов, ведь они должны решить, какие страницы сайта нужно индексировать.

Тем самым, роботы впустую тратят свое время на сканирование страниц, которые затем поисковики пометят как дублированный контент.

При этом, страницы которые действительно важны для сайта, могут быть не проиндексированы, поскольку краулинговый бюджет уже израсходован из-за сканирования дублированных страниц контента.

Как решить проблемы с дублированным контентом?

Что касается технических дублей, используйте тег canonical. А что касается просто похожих страниц, то для решения этой проблемы, прочитайте статью про канибализацию ключевых запросов.

5. Избавиться от тонкого, малополезного контента.

Подобно дублированному контенту, еще один фактор, который может повлиять на бюджет сканирования, — это тонкие страницы контента.

Тонкий контент — это страницы вашего сайта, на которых малополезный контент, который либо вообще не приносит пользу посетителю, либо имеют совсем мало пользы. Такие страницы также известны как низкого качества или малополезные страницы.

Подробнее о них, читайте здесь.

6. Избегайте слишком большого количества редиректов

Еще одна проблема, которая может замедлить частоту сканирования веб-сайта, связана с наличием слишком большого числа редиректов.

Редиректы являются отличным способом решения проблем с дублированным содержимым и с ошибками 404, но следует позаботиться о том, чтобы не создавать цепочки перенаправлений.

Когда робот Google обнаруживает редирект 301, он может не сканировать перенаправленный URL-адрес сразу, а добавит в список URL-адресов для сканирования. В результате, такие ненужные к индексации страницы, будут расходовать ваш краулинговый бюджет.

7. Убедитесь, что у вас нет взломанных страниц

Взлом веб-сайта может обеспокоить гораздо больше, чем краулинг бюджет, но вы должны знать, как взломанные страницы влияют на краулинговый бюджет.

Если вы вовремя не заметили, что ваш сайт взломан, то поисковики, увидев что сайт взломан, станут наведываться на него значительно реже.

Чтобы избежать этой ситуации, регулярно проверяйте свой сайт в вебмастере поисковиков. Если сайт станет подозрительным, то в них появится оповещение.

8. Улучшите репутацию вашего сайта (Внешние ссылки)

Популярные URL-адреса сканируются поисковыми системами чаще, потому что они хотят, чтобы содержание этих страниц обновлялось в индексе.

В мире SEO самым большим фактором, для различия популярных страниц от непопулярных, является количество и тип обратных ссылок.

Обратные ссылки помогают установить доверие с поисковыми системами и улучшить авторитет страницы, что в конечном итоге приводит к повышению рейтинга.

Это одна из фундаментальных концепций SEO, которая не менялась годами.

Таким образом, наличие у страницы обратных ссылок побудит поисковые системы чаще посещать эти страницы, что приведет к увеличению бюджета сканирования.

Получить ссылки с других сайтов непросто, на самом деле это один из самых сложных аспектов в SEO, но это сделает ваш сайт сильнее и улучшит общее SEO.

Как проверить отчет о краулинговом бюджете?

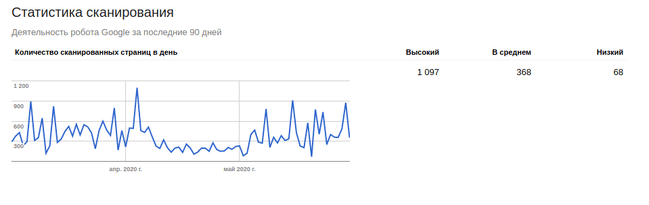

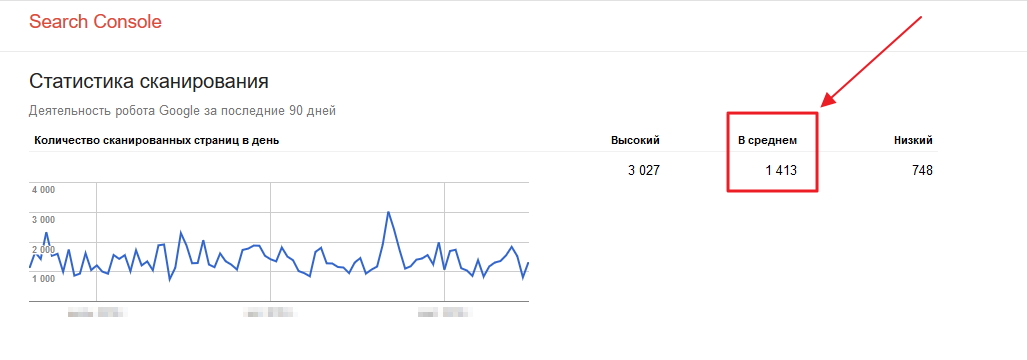

Несмотря на то, что вам не следует слишком зацикливаться на краулинговом бюджете, время от времени полезно просматривать отчет «Статистика сканирования» в поисковой консоли Google и искать какие-либо ненормальные действия.

Для этого перейдите в консоль, и вы сможете увидеть отчет.

Этот отчет показывает информацию обо всех действиях Googlebot на вашем сайте за последние 90 дней.

В отчет будет включена любая попытка Googlebot получить доступ к любому ресурсу вашего сайта, к таким как страницы, изображения, файлы CSS, файлы js, и все то, что вы загрузили на свой сервер и к чему не закрыли доступ в файле robots.txt.

По этой же причине количество «страниц, просканированных за день» больше, чем количество страниц сайта в индексе Google.

Что искать в отчете по статистике сканирования?

При просмотре отчета постарайтесь выявить внезапные падения или всплески количества страниц, просканированных за день. Посмотрите на период в две недели или месяц и посмотрите, является ли падение или всплеск постоянным.

В нормальных условиях количество страниц для сканирования должно постоянно увеличиваться (при условии, что вы регулярно добавляете новый контент на сайт). Если вы не вносите никаких изменений, шаблон должен быть похожим, если вы сравниваете два периода времени.

Внезапное падение скорости сканирования может произойти, когда:

Скорость сканирования может резко возрасти, когда:

Поэтому, если отчет не отображает того, что вы сделали со своим сайтом, значит вам нужно искать причину этого. Но в большинстве случаев вам не стоит беспокоиться о краунгивом бюджете.

Краулинговый бюджет сайта — что это и как его оптимизировать?

Краулинговый бюджет влияет на индексацию сайта.

Индексация влияет на способность сайта приносить экономические выгоды.

Что такое краулинговый бюджет? На основе каких данных формируется значение?

Как улучшить ситуацию с индексацией сайта?

Разберемся с вопросами далее.

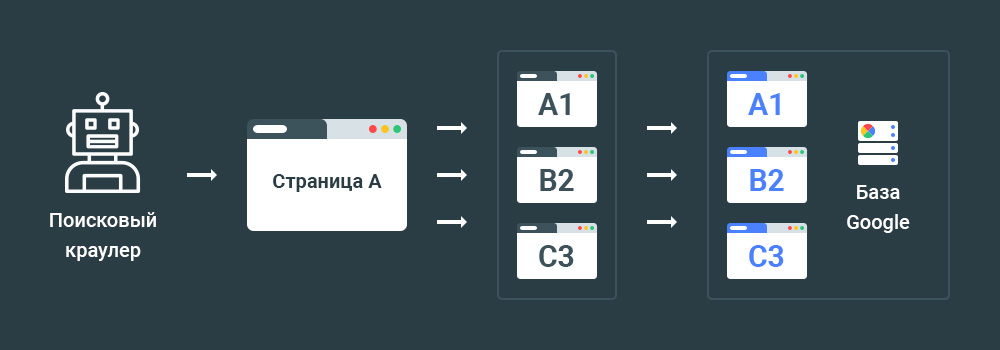

Как происходит индексация сайта?

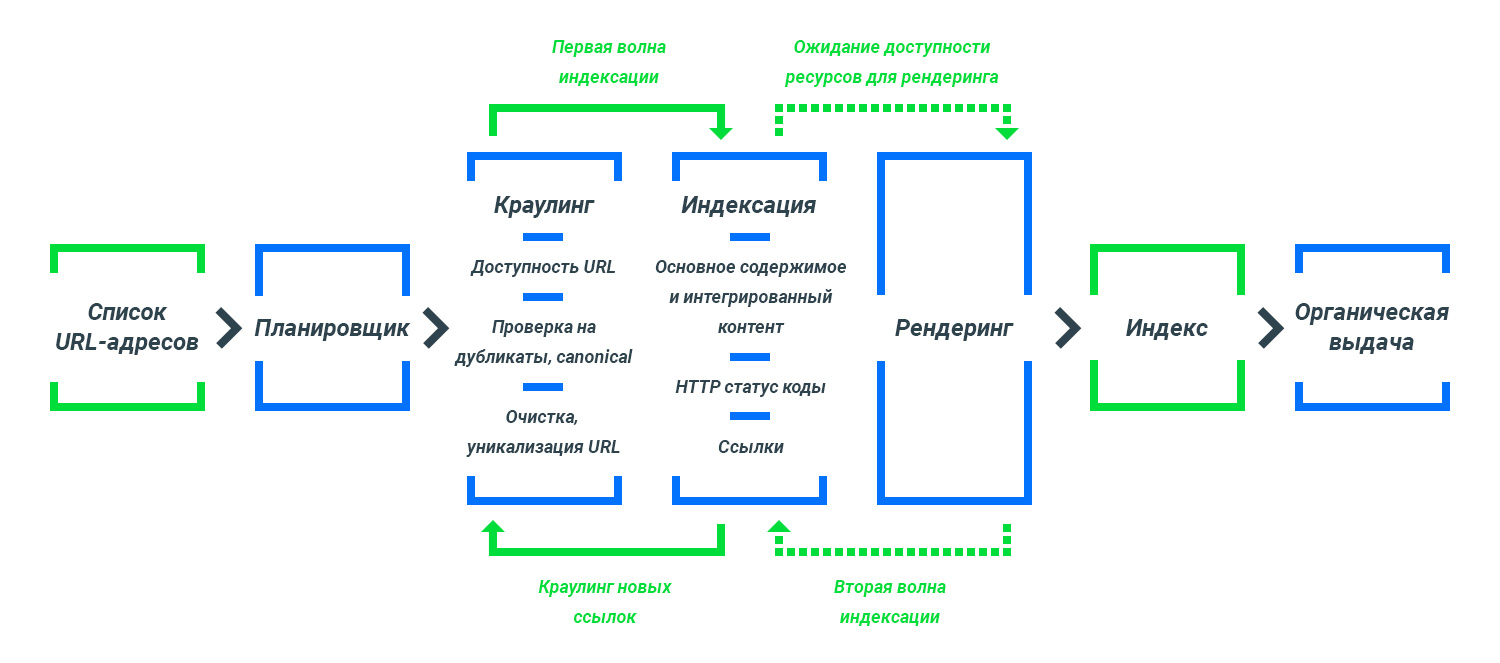

Попадание страницы в индекс поисковой системы происходит после посещения страницы поисковым краулером.

Далее страница обрабатывается системой краулинга. На следующем этапе страница оценивается системой ранжирования.

Весь процесс выглядит так:

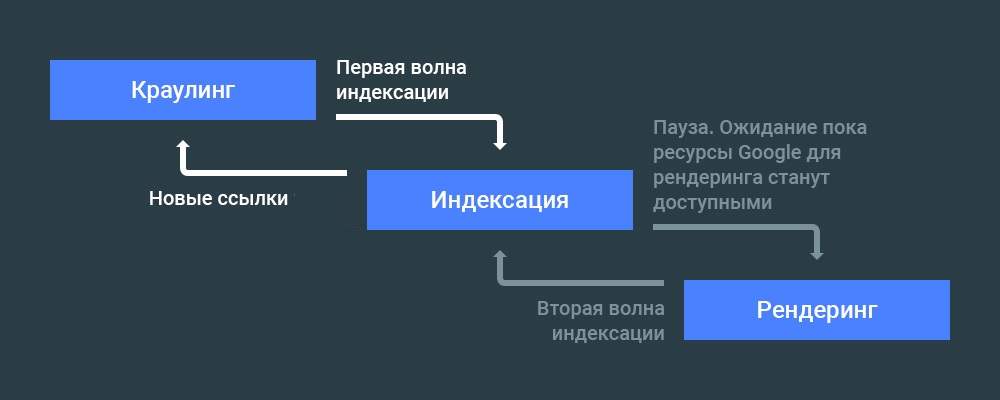

Скорость попадания страниц в поисковую выдачу напрямую зависит от наличия на странице кода JavaScript.

Если на странице есть код JavaScript, то обработка происходит в 2 волны.

Если на странице требуется использовать ленивую загрузку, то не обязательно использовать JavaScript. Для реализации ленивой загрузки можно использовать атрибут loading=lazy. Рекомендованный материал в блоге MegaIndex по теме атрибута loading по ссылке далее — Появился новый атрибут тега img, который позволяет ускорить загрузку сайта. Пример реализации.

Итак, если на странице есть JavaScript, то поисковая система будет выполнять рендеринг страниц с учетом выполнения кода. После рендеринга страница попадает на анализ в систему ранжирования.

Но в поисковых системах есть метрика, которая используется до инициализации процесса сканирования сайта. От значения данной метрики зависит дальнейший процесс индексации.

Данная метрика называется краулинговым бюджетом сайта.

От значения краулингового бюджета зависит количество страниц, которое краулер обработает в рамках посещения сайта.

Краулинговый бюджет

Итак, в поисковых системах для сайтов рассчитывается специальный параметр, от которого зависит процесс индексации.

Что такое краулинговый бюджет? Краулинговый бюджет — это метрика, которая определяет квоту страниц хоста, подлежащих индексации в рамках одного визита краулера поисковой системы.

Если значение количества страниц вне индекса превышает пороговое значение краулингового бюджета, то ряд страниц сайта добавлен в индекс поисковой системы не будет.

Страницы не будут проиндексированы, и не будут оценены системой ранжирования даже в том случае, если поисковая система имеет сведения о данных страницах.

Значение краулингового бюджета для каждого сайта рассчитывается на индивидуальной основе.

Как рассчитывается краулинговый бюджет?

Итак, в плане индексации поисковая система по-разному оценивает каждый сайт. Объем страниц, которые подлежат индексации зависит от краулингового бюджета сайта.

От чего зависит значение краулингового бюджета? Вопреки расхожим мифам на значение краулингового бюджета влияет только два фактора.

Числовое значение краулингового бюджета зависит от таких факторов:

Как повысить краулинговый бюджет сайта?

Манипуляции с файлом sitemap.xml не влияют на краулинговый бюджет.

Настройка директив robots не влияет на краулинговый бюджет.

А что работает? На практике повышение числового значения краулингового бюджета может быть достигнуто следующими способами:

Какие работы следует провести для оптимизации способности сервера обрабатывать запросы, без снижения скорости загрузки? Сначала следует провести анализ динамики скорости отдачи контента при сканировании сайта краулерами.

Выявить визит краулера можно на основе данных из логов сервера. Если скорость не понижается, никаких дополнительных мер выполнять не следует.

Если скорость понижается, далее список мер следующий:

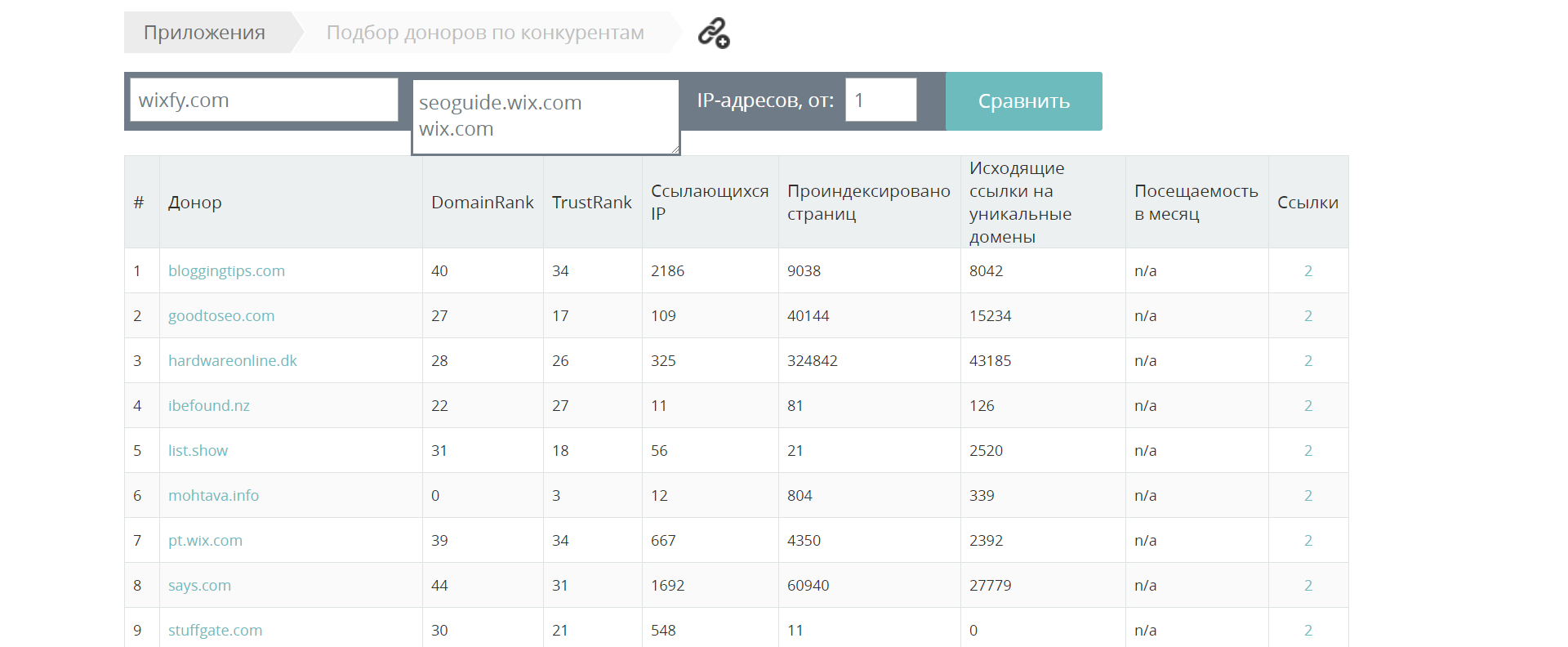

Для реализации задачи на практике существуют специальные инструменты. Например, инструмент для поиска сайтов, на которых размещены ссылки сразу на несколько конкурентных проектов. Для выгрузки результата достаточно ввести продвигаемый сайт и список конкурентов.

Пример. Сайт wixfy.com. Тематика сайта — продвижение в поисковых системах сайтов, которые созданы на Wix. Есть как минимум 3 сайта, освещающие тему поисковой оптимизации сайтов на Wix.

Выгрузка по отчету следующая:

Рекомендованные материалы в блоге MegaIndex на тему повышение авторитетности сайта путем внешней оптимизации по ссылкам далее:

Как улучшить индексацию сайта в рамках текущего значения краулингового бюджета?

Зачастую в индекс поисковой системы попадают ненужные и/или неприоритетные страницы сайтов.

Серьезные проблемы с краулинговым бюджетом появляются в таких случаях:

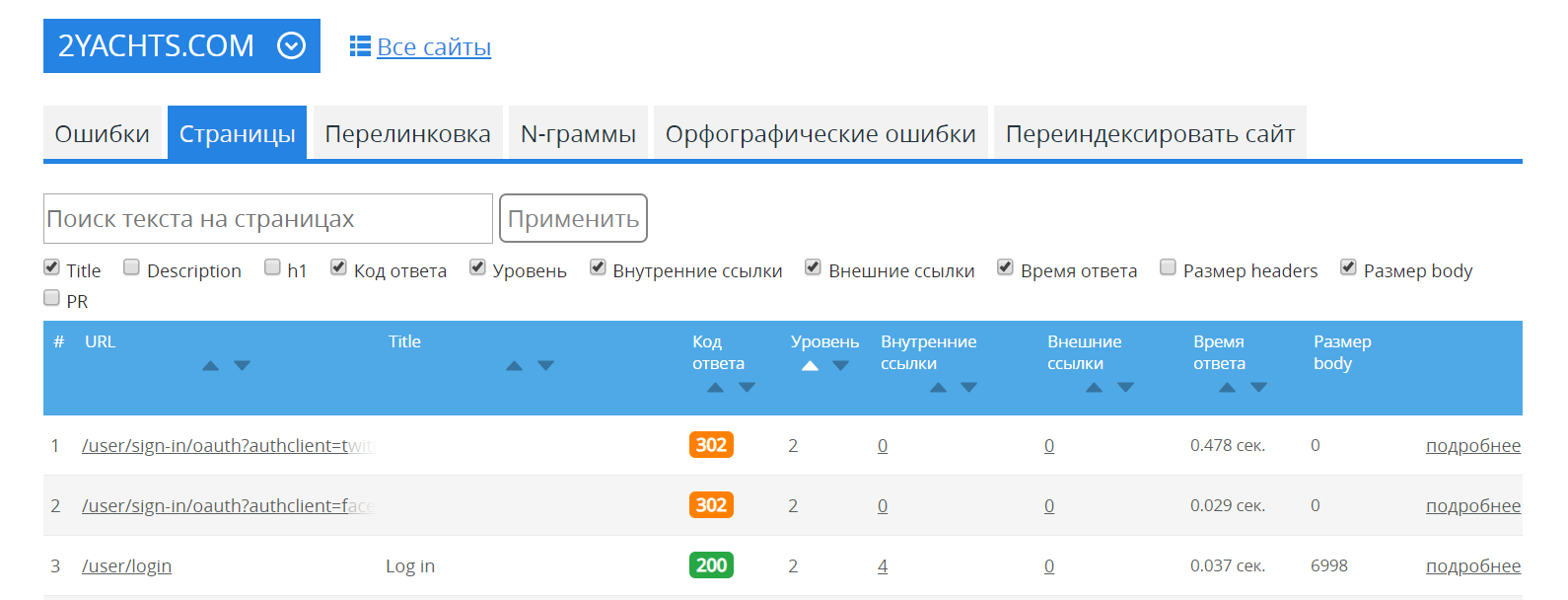

Сервис бесплатный.

Сервис позволяет провести сканирование сайта и найти страницы сайта с маленьким значением размера body. Зачастую такие страницы являются техническими и ненужными, но попадают в индекс поисковой системы. Выявление таких страниц является основной для дальнейших действий по оптимизации системы управления.

Вопросы и ответы

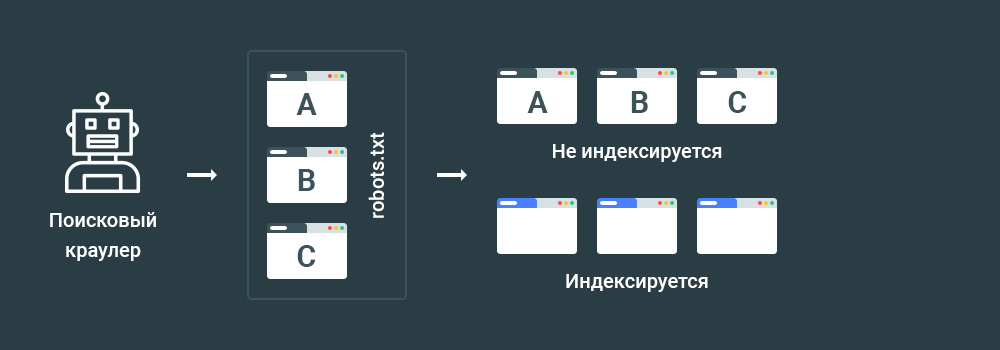

Влияет ли robots.txt на краулинговый бюджет?

Применяя данную директиву можно задать список страниц, которые поисковому краулеру следует игнорировать, то есть не посещать.

Но указанные в файле robots.txt директивы являются не обязательными к исполнению поисковой системой.

Влияет ли запрет индексации в мета-теге robots на краулинговый бюджет?

Директивы в мета-теге являются обязательными к исполнению в поисковых системах Google, Bing и Yandex. Поисковый краулер действительно не будет отправлять такие страницы на обработку в целях индексации.

Рекомендованный материал в блоге MegaIndex по теме применения директив robots на сайте по ссылке далее — Как удалить страницы из индекса поисковых систем? Какие страницы нужно удалить из выдачи? Зачем?

Но краулер поисковой системы все равно может посещать такие страницы, если на такие страницы есть ссылки.

В результате краулинговый бюджет будет расходоваться также и на ненужные в индексе страницы.

Как узнать краулинговый бюджет на текущий момент?

Краулинговый бюджет зависит от авторитетности сайта и способности сервера обрабатывать запросы, без снижения скорости загрузки сайта.

Значение может меняться, как в большую, так и меньшую сторону.

Узнать точное значение по текущему бюджету на сканирование можно путем анализа логов сервера.

Что будет, если не оптимизировать краулинговый бюджет?

Если не выполнен комплекс мер по поисковой оптимизации краулингового бюджета сайта, то негативные последствия для проекта заключаются в следующем:

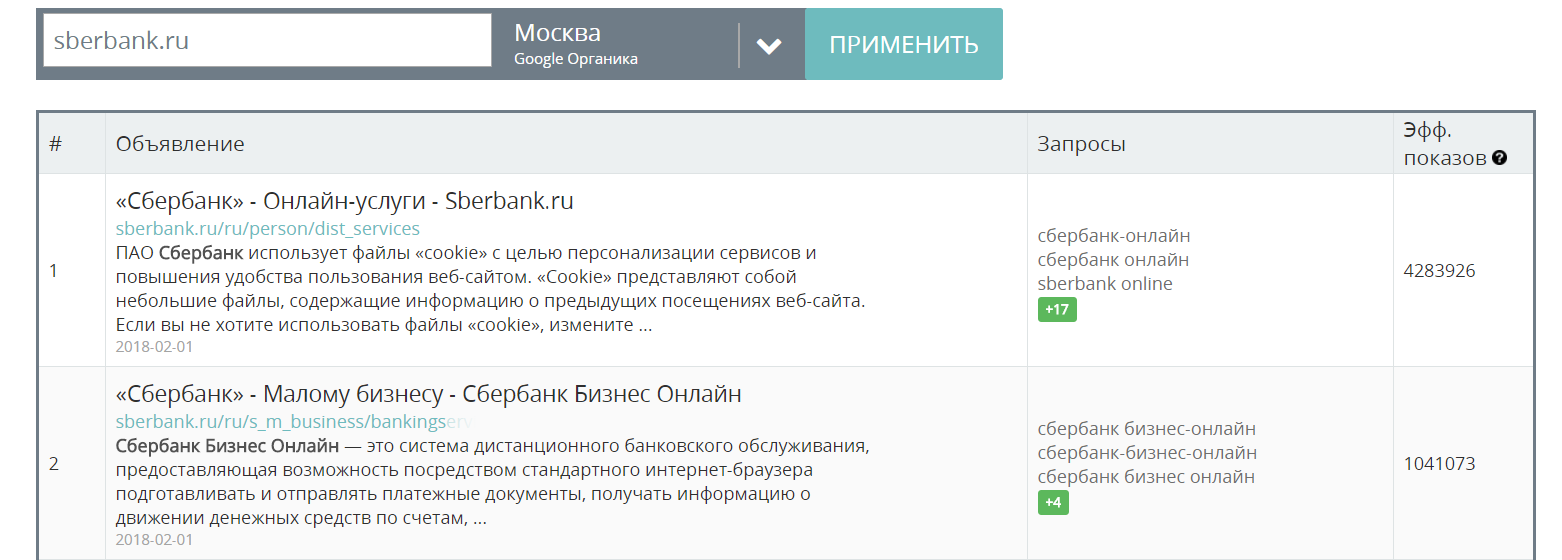

Для увеличения кликабельности в поисковой выдаче следует создавать привлекательный сниппет. Для решения задачи по созданию кликабельных сниппетов можно использовать анализ сниппетов страниц конкурентных сайтов.

Рекомендованные материалы в блоге MegaIndex по теме сниппетов по ссылкам далее:

Выводы

Индексация сайта напрямую влияет на трафик, а следовательно на показатель конверсии и способность сайта приносить экономические выгоды.

Попадание страниц в индекс поисковых систем зависит от краулингового бюджета.

Краулинговый бюджет поискового робота является числовым значением, от которого зависит количество страниц, которое может быть добавлено в индекс поисковой системы.

Важно, чтобы в индекс поисковых систем попали все приоритетные страницы сайта.

Низкое значение краулингового бюджета и/или расход бюджета на ненужные страницы приводит к потере трафика.

Нужные страницы могут не индексироваться.

Если нужные страницы не индексируются, то контент сайта может быть украден и опубликован на другом сайте.

Иначе трафик сайта будет уменьшаться. Уменьшение целевого трафика влечет уменьшение охвата и экономической выгоды от сайта.

Значение crawl budget в автоматическом режиме регулируется такими параметрами как авторитетность сайта и способности сервера обрабатывать запросы, без снижения скорости загрузки.

Улучшить авторитетность сайта можно посредством оптимизации внешнего ссылочного профиля.

Улучшить производительность сервера можно посредством смены платформы. Альтернативным вариантом является имплементация технологии server side rendering.

В результате все нужные страницы сайта будут добавляться в индекс поисковой системы.

В рамках текущего краулингового бюджета следует выполнить такие задачи:

Краткий ликбез: что такое краулинговый бюджет и как его оптимизировать

20.09.2019 Время прочтения: 4 минуты

Что такое краулинговый бюджет?

Краулинг (англ. crawling) в терминологии SEO — это сканирование поисковым роботом страниц сайтов, их индексация для формирования поисковой выдачи.

Краулинговый бюджет — это лимит, который выделяется каждому сайту на это сканирование. То есть это ограничение числа страниц, которые поисковой робот может проиндексировать в заданный временной промежуток.

Этот термин ввела компания Google, поэтому его соотносят в первую очередь с деятельностью Googlebot.

Краулинговый бюджет рассчитывается для каждого сайта отдельно, исходя из его пользовательского спроса и доступности сервера.

Кому и зачем нужно уметь им управлять?

Владимир Суматохин, технолог SEO-эксперт компании SEO.RU:

«Краулинговый бюджет часто остается без внимания. Если вы владеете небольшим сайтом или оптимизируете его, то причин для беспокойства нет. Но если у вас крупный проект, то оптимизация краулингового бюджета жизненно необходима, поскольку окажет влияние на ранжирование сайта в поисковых системах. В противном случае может оказаться, что часть вашего сайта не проиндексирована и не участвует в поиске».

Зачем оптимизировать бюджет на индексацию? Чтобы не растрачивать его впустую.

Смотрите: Google определяет бюджет на индексацию вашего сайта — допустим, это 200 страниц в сутки. Может показаться, что это много, но если ваш веб-ресурс — это огромный интернет-магазин с постоянно обновляемым ассортиментом, то 200 только новых страниц на вашем сайте может появиться за 1 день. А есть и другие страницы, которые тоже нужно выводить в поисковую выдачу. Робот может не обойти все за раз.

Другая частая проблема: в индекс попадают страницы по низкочастотным запросам, а по высокочастотным — пролетают. Например, страница с брелоком в виде розового игрушечного крокодила попадет в топ, а раздел со всем ассортиментом брелоков — нет.

Поэтому без оптимизации краулингового бюджета начнутся проблемы с индексацией всего сайта: если у поискового робота на определенной странице закончится бюджет, то остальные для него просто перестанут существовать.

Где посмотреть краулинговый бюджет своего сайта?

Вся история про лимит индексации завязана на Google, поэтому самый удобный способ — это посмотреть статистику обхода в Google Search Console.

Для этого нужно открыть меню «Прежние инструменты и отчеты», а затем кликнуть на «Статистику сканирования»:

Графики со статистикой откроются в новом окне. Среди них нам важен первый — «Количество сканированных страниц в день». То число страниц, которое Googlebot в среднем сканирует за день, и есть краулинговый бюджет сайта:

Это не абсолютная и постоянная величина — эта цифра может увеличиваться и уменьшаться, но как примерный показатель работает.

Как оптимизировать краулинговый бюджет?

Краулинг — это индексация, поэтому весь лимит быстро тратится именно из-за ошибок индексации. В рамках SEO-продвижения сайта их нужно исправлять.

Эти файлы помогают поисковым роботам правильно индексировать ваш сайт, строить его иерархию и видеть, как организован контент.

Что конкретно сделать:

Чем меньше загружается сайт, тем быстрее его просканирует бот: в рамках одинакового числа соединений он сможет проанализировать большее количество страниц.

Когда роботу нужно пройти 100500 переадресаций, чтобы добраться до страницы, он может остановиться на 100499 и просто не достичь этого URL. Каждый редирект — это траты вашего бюджета на индексацию. Убедитесь, что имеющиеся редиректы на вашем веб-ресурсе действительно необходимы.

А именно: используйте уникальные и разнообразные анкоры с ключевыми словами и добавляйте ссылки на тематически соответствующие страницы.

Это относительно новая разработка все того же Google, которая для поискового робота создает HTML-версию сайта, а для пользователя — вариант на JavaScript. Это облегчает и ускоряет индексацию.

Экспериментальные данные говорят о весьма заметной связи между количеством посещений сайта поисковым роботом и числом внешних ссылок: чем больше ссылок, тем чаще Googlebot наведывается на площадку.

Что такое краулинговый бюджет

В связи со сканированием URL сайта существует два показателя:

Краулинговый спрос — это определенное количество URL, которые Google намеревается просканировать на веб-ресурсе.

Краулинговый бюджет — это лимит страниц сайта, которые поисковый паук сможет обойти за какую-то единицу времени. Иногда робот просто не способен обойти все страницы за один раз, поэтому нужно принимать меры для оптимизации этого показателя.

Рассмотрим пример интернет-магазина с большим количеством категорий/подкатегорий и широким набором фильтров.

Важно, чтобы в индекс попали все приоритетные посадочные страницы. В противном случае вы будете терять целевых посетителей из органики, которые могли бы стать вашими клиентами.

Например, ваша CMS генерирует много мусорных URL, которые попадают в sitemap, а потом в индекс. Это влечет за собой ряд негативных последствий: мало того, что вы зря расходуете краулинговый бюджет на подобные URL, но еще и ваш краулинговый бюджет может сократиться, так как бот оценивает качество URL.

Или второй пример: для любого интернет-магазина важна удобная фильтрация. Для этого создаются фильтры, которые формируют множество комбинаций. Чтобы увидеть, какое количество страниц создается из-за комбинаций фильтров возьмем пример из интернет-магазина косметики — страница Крем для лица.

Составляем такую табличку: список названий и значений фильтров (на картинке только бренды на букву А).

Эти файлы важны для сканирования сайта. Они сообщают боту организацию контента, помогают находить свежий контент.

Блокируйте мусорные страницы в robots.txt, не допускайте их попадания в карту сайта. В sitemap должны попадать только полезные страницы, освобождайте ее от мусора, URL с редиректами, canonical, ошибками сканирования.

Не забывайте указывать в карте сайта last-modified, чтобы избежать повторного сканирования страниц, которые не менялись после того, как ее просканировали. Это также позволит не растрачивать впустую краулинговый бюджет, Google бот пойдет дальше по измененным или новым страницам. Так он сможет проиндексировать новые страницы, а не заходить на те, которые уже ранее сканировал.

Это современная технология, которая способна облегчить сканирование, попадание в индекс и ранжирование javaScript страниц. С помощью этого метода вы сможете предоставлять боту Google html-версию, а пользователю при этом показывать javaScript-версию страниц.

Согласно Google, не все краулеры способны быстро и благополучно обрабатывать javaSсript. Конечно, нам все обещают, что этот вопрос будет решен, но на сегодня Google рекомендует применять именно динамический рендеринг.

Как это работает?

Нужно, чтобы сервер определял краулер. Запросы от краулеров будут передаваться рендереру, а от пользователей — обрабатываться в обычном режиме. При необходимости динамического рендеринга будет предоставляться версия контента, которая подобрана для определенного краулера. Например, для бота показываем статическую HTML-версию.

Динамический рендеринг можно настроить на всех URL сайта или на определенных. Так вы сможете облегчить боту сканирование страниц вашего сайта. Он не будет тратить лишние ресурсы на загрузку всех деталей, а сразу получит HTML-версию. Как пошагово внедрить рендеринг на сайте читайте в статье блога Google.